热门主题

BCS 2021产业峰会:百度首席安全科学家谈利用安全技术防范AI系统风险

2021-08-30 17:49:2819796人阅读

8月27日上午,2021北京网络安全大会产业峰会举行,百度首席安全科学家李康发表题为《应用形式化验证技术保护AI系统安全和隐私》的主题演讲。李康表示,AI系统安全风险的产生,主要来源于系统的复杂度。为了应对AI系统的复杂性,百度安全从AI Safety,AI Security,和AI Privacy 三个维度研究AI系统的安全验证与防御方法。

李康在演讲中指出,除了对抗性深度学习以及深度学习可解释性的研究,百度安全应用了多种系统安全技术,尤其是形式化验证技术来防范AI系统风险。形式化验证技术已经在航空,制造等领域被广泛使用,用来测试系统安全性,最大程度保障航空领域的自动起降,自动调度等的安全性。

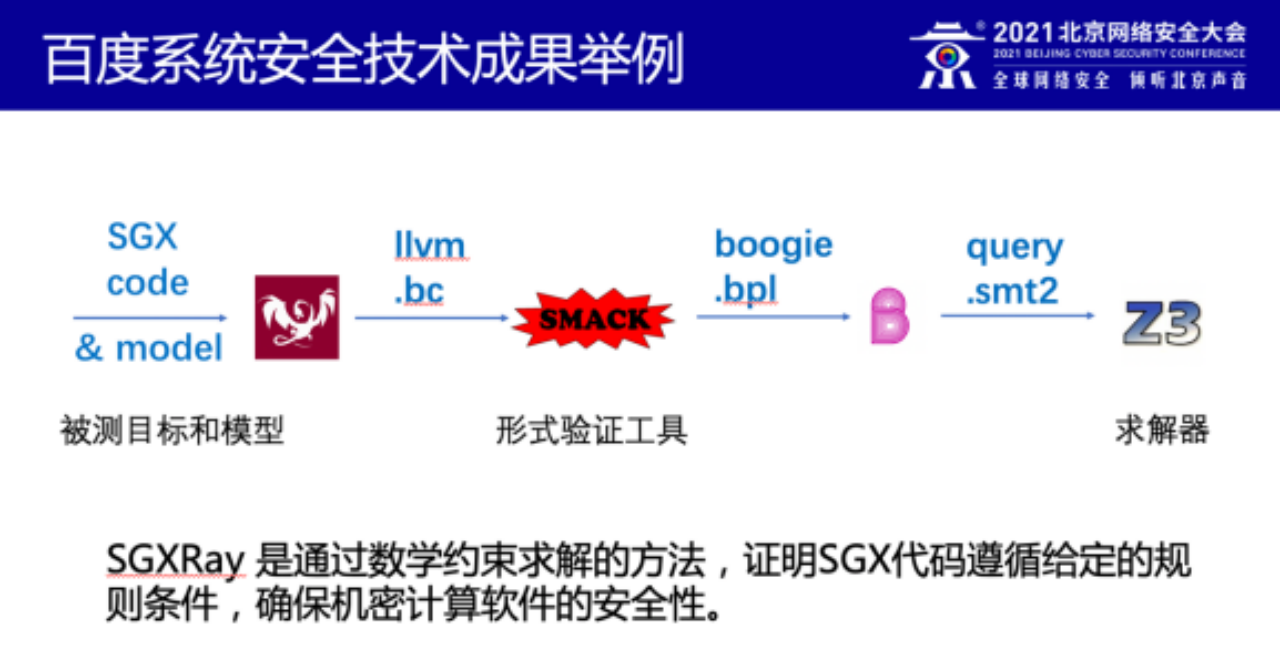

在隐私保护方向,百度已经成功应用形式化验证技术到基于硬件的机密计算中。 当利用机密计算保护AI训练和推理时,即便是使用了硬件防御机制,软件栈上的设计不当,尤其是与硬件编程模型的差异性,会导致敏感信息泄露。 百度利用形式化验证技术,通过数学建模,逻辑求解的方法,构建模型和验证程序。通过数理逻辑约束求解的方法对软件行为进行验证,提前检测出埋藏在隐私安全计算软件中的风险,确保AI应用得到正确的隐私保护。

在AI Safety 方向,百度公司一直长期投入自动驾驶技术研究。百度安全也已经把多种系统安全技术应用到自动驾驶系统中,确保AI系统在各种场景下的安全与稳定。

举例来说,李康表示,目前百度安全已将模糊测试(Fuzzing)技术,模式检查(Model Checking)技术植入自动驾驶软件测试中。 百度安全搭建了百度ASF平台,结合3D仿真和车辆自动驾驶系统做场景变异,利用车辆轨迹作为测试覆盖率信息。 李康强调,这便是Fuzzing技术应用到自动驾驶中的一个创新。而在形式化验证方面,百度利用模式检查来验证系统是否在运行时执行安全驾驶,遵守交规,行为是否符合预期。

李康表示,百度安全会持续关注AI安全,从Safety,Security,Privacy 三个方面做好防御工作。防御手段将会是系统安全技术与应用层防御结合,从多个维度全方位保护AI系统的安全。